Введение

Перед вами статья, написанная по мотивам обучения рекламного агентства RODNYA Creative PR Studio, которое проводила Карина Садова — руководитель направления ИИ в X5 Digital.

Материал задуман как лёгкое и понятное вечернее чтение без погружения в технические детали. Здесь не будет сложной теории — только суть и практические принципы.

Почему эта статья будет вам полезна

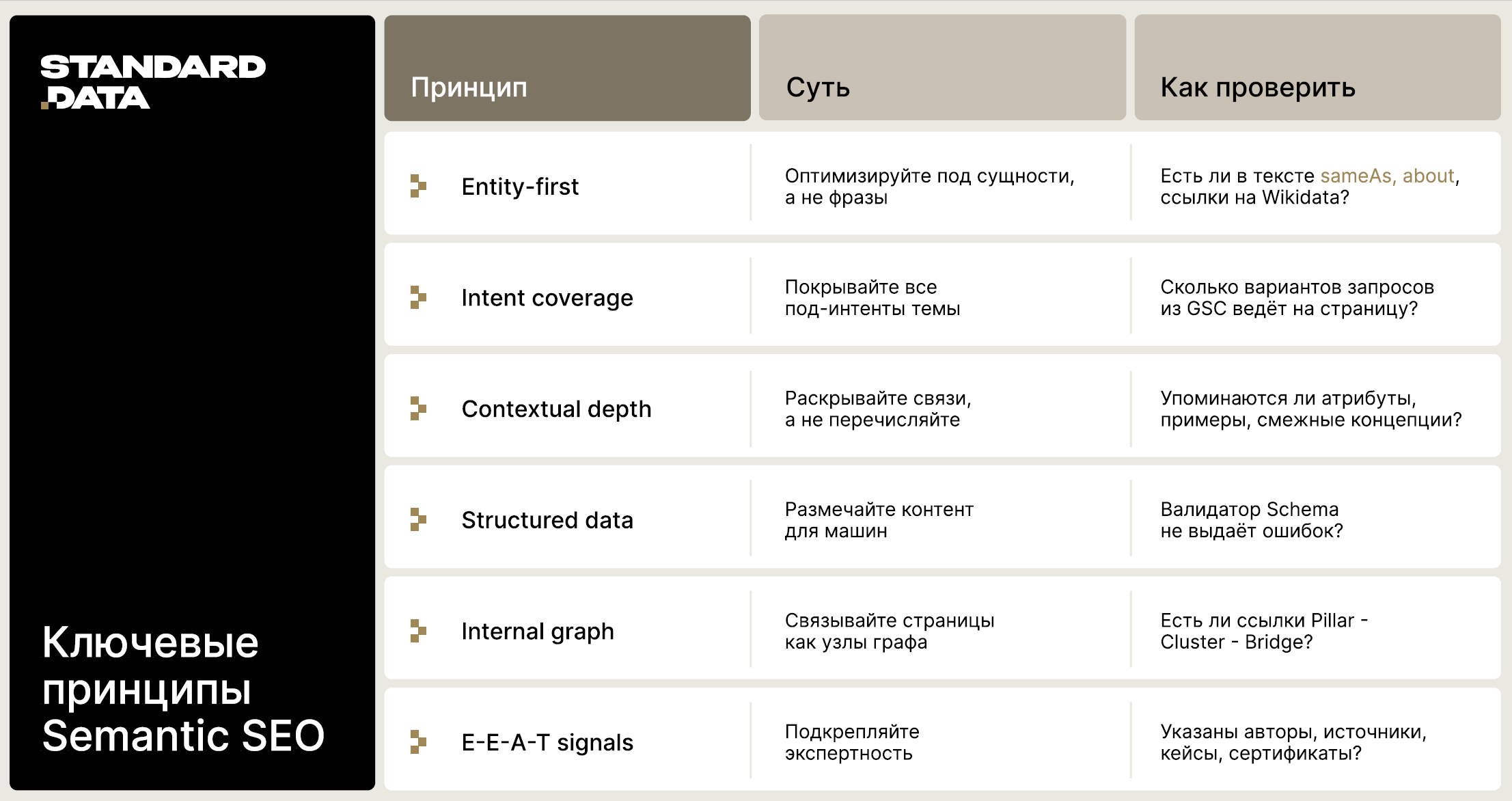

Сегодня продвигать контент «по старым правилам SEO» уже недостаточно. Поисковые системы встроили LLM и научились оценивать не просто ключевые слова, а смысл, структуру и реальную пользу текста. Поэтому главный вопрос теперь звучит иначе: не как обмануть алгоритм, а как сделать материал, который алгоритм сам выберет.

В этой статье разберём, как писать и оформлять контент так, чтобы он попадал и в классическую выдачу, и в ответы нейросетей.

Главный принцип семантического SEO

Если понять основной принцип, все остальные рекомендации будут уже скорее вспомогательными.

Суть в том, что информация в вашем контенте — независимо от темы, формата и площадки — должна быть полной и структурированной.

С одной стороны, текст должен быть организован: с заголовками, подзаголовками, ответами на вопросы, логичными блоками. Это не должен быть сплошной массив текста.

С другой стороны, из него должно быть понятно:

-

о чём вообще идёт речь;

-

на какой вопрос отвечает материал;

-

для какого пользователя он предназначен;

-

чью проблему решает;

-

что это за проблема.

То есть контент должен содержать как можно больше ясной и конкретной информации о своём назначении.

При этом нельзя делать страницу «для всех сразу»: и для этой аудитории, и для другой, и для всех проблем одновременно. Такой подход раньше ещё мог как-то работать в классическом SEO, но в семантическом SEO он уже неэффективен.

Системы видят, когда контент слишком общий и ни под кого конкретно не заточен. Такая информация получает меньший вес и уходит ниже. А специализированный контент, который очень точно отвечает на конкретный запрос пользователя, наоборот, получает более высокий приоритет.

Вокруг чего строить контент

Одна из основных отправных точек — поисковое намерение пользователя. То есть нужно понимать, зачем человек делает запрос и что именно хочет получить.

Отсюда следуют вполне знакомые практики:

-

смотреть популярные запросы,

-

писать статьи под конкретные темы,

-

собирать тематические кластеры,

-

раскрывать одну большую тему через несколько связанных материалов.

Это не совсем новая история. Так делали и раньше. Но в семантическом SEO акцент усиливается: информация должна быть не только структурированной, но и специализированной, а также связанной между собой.

Связанность здесь важна в двух смыслах.

Во-первых, это внутренняя связанность: когда тема раскрывается через несколько материалов, и они дополняют друг друга с разных сторон.

Во-вторых, это внешняя связанность: когда ваш контент цитируется, упоминается на других ресурсах и встраивается в более широкий информационный контекст. Это тоже повышает его вес.

Почему это работает

Никто специально не придумывал все эти правила только ради продвижения через LLM. Эти принципы появились раньше — ещё в среде производителей контента и SEO-специалистов до широкого распространения языковых моделей.

Просто оказалось, что LLM особенно хорошо продвигают именно качественный, структурированный и понятный контент:

-

у которого есть свой читатель;

-

своя задача;

-

своя проблема, которую он решает.

А вот дублирующий, слабый, водянистый или бессодержательный контент, наоборот, продвигается плохо.

Причина простая: языковые модели хорошо умеют анализировать большие объёмы информации. Благодаря этому поисковые системы смогли автоматизировать отбор и сравнение контента в интернете гораздо качественнее, чем раньше.

Для поисковиков это тоже выгодно. Чтобы люди продолжали ими пользоваться, им нужно как можно быстрее давать максимально полезную информацию под конкретный запрос. Иногда — даже предугадывать, что именно пользователь хотел узнать, и сразу выдавать краткую выжимку, не заставляя его открывать десятки ссылок.

Именно поэтому поисковые системы так быстро встроили языковые модели в свои продукты.

Что это значит на практике

Если упростить, то для хорошей SEO-оптимизации сегодня нужно просто делать хороший контент. Как бы банально это ни звучало, это так.

Но, конечно, «хороший контент» — понятие растяжимое, и каждый может понимать его по-своему. Поэтому и нужны правила: чтобы было понятно, какой именно контент поисковые системы считают полезным и достойным продвижения.

И ещё важный момент: поисковые системы не остались в стороне от ИИ-революции. Они не проиграли нейросетям конкуренцию, а встроили их в себя как в привычный интерфейс, которым люди пользуются уже десятилетиями.

По сути, поисковики объединили свою инфраструктуру с сильной стороной LLM — способностью быстро суммаризировать огромные объёмы информации и находить в них суть.

И это как раз один из лучших сценариев применения языковых моделей: не просто выдавать ответ «из головы», а анализировать большие массивы текстов, собирать из них суть и возвращать пользователю короткий, полезный и понятный результат.

Раньше, когда мы искали информацию через Google, приходилось читать одну статью, потом вторую, третью, десятую. Проходило два часа, голова забивалась лишней информацией, а качество самих материалов далеко не всегда было высоким.

Интеграция LLM в поисковые системы изменила эту логику. Теперь не нужно читать двадцать статей, чтобы составить общее представление по вопросу. Поисковая выдача сама суммаризирует информацию и сразу показывает пользователю выжимку. При этом сама выдача проходит двойной отбор: с одной стороны, работают классические алгоритмы ранжирования, а с другой — дополнительный отбор и переоценка информации через LLM.

Именно так сейчас устроен этот процесс.

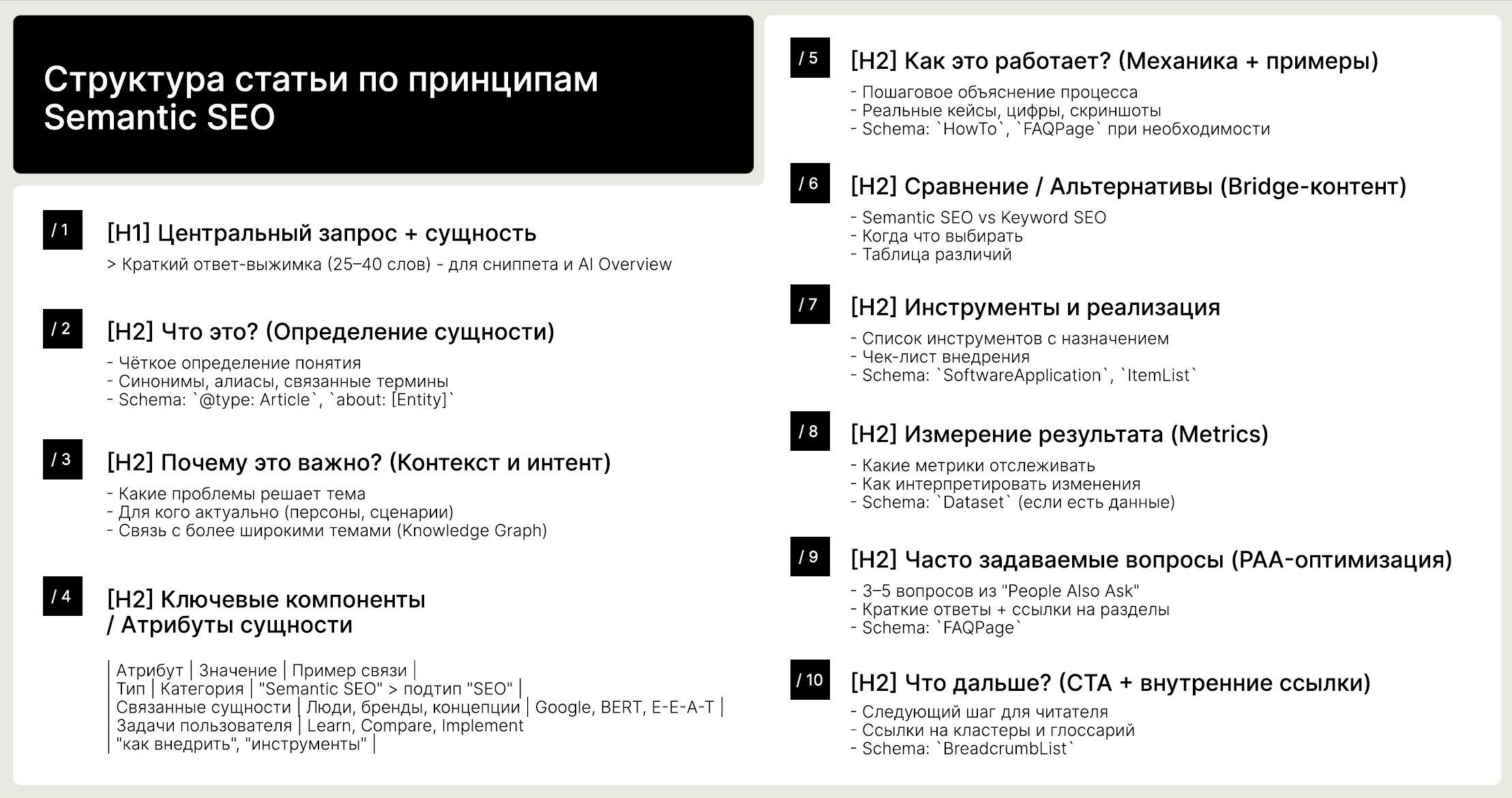

Как написать семантически оптимизированную статью

Если, например, мы пишем статью под запрос «Как выбрать беговые кроссовки», то задача — структурировано разложить по полочкам всё, что нужно пользователю для принятия решения.

Нужно объяснить:

-

для каких задач подходят разные кроссовки;

-

какие бывают особенности стопы;

-

какие есть бренды;

-

какие технологии используются;

-

какие параметры важны при выборе.

То есть статья должна формировать у пользователя ясную систему ориентиров.

Если же мы продвигаем конкретный товар, подход немного меняется. Не нужно писать, что эти кроссовки подходят вообще для всего: и для такой стопы, и для другой, и для бега, и для ходьбы, и для Эвереста. Вместо этого надо так же структурированно описать, для кого и для каких задач этот товар подходит:

-

для каких людей;

-

для каких условий;

-

для каких погодных сценариев;

-

для каких особенностей использования.

Если это обзорная статья, то она должна честно давать именно информацию: помогать человеку выбрать. Если это карточка товара, то она должна быть встроена в ту же логику выбора и закрывать конкретные сценарии, но не пытаться быть «для всех сразу».

Так мы покрываем нужную семантическую область и повышаем шансы продвинуться по релевантным запросам.

Как оформлять такой контент

Для семантической оптимизации очень важно оформление.

Нужно использовать:

-

чёткую иерархию заголовков;

-

markdown-разметку или аналогичную логичную структуру;

-

списки;

-

короткие и ясные абзацы;

-

понятные блоки текста.

Связный текст тоже нужен, но он не должен быть расплывчатым. Важен принцип answer first: в первых одном-двух предложениях нужно сразу дать суть ответа, а уже потом раскрывать её подробнее.

То есть мы не начинаем издалека и не заставляем читателя или нейросеть выискивать, о чём вообще материал. Сразу должно быть понятно:

-

что это;

-

для чего это;

-

на какой вопрос отвечает текст.

Это полезно не только для нейросетей, но и для людей. Когда человек открывает статью, он не хочет пробираться через поток сознания автора в поисках нужной мысли.

Интересно, что языковые модели сами обычно отвечают примерно по этим же принципам. Поэтому, если хочется лучше понять семантически оптимизированный стиль, полезно просто посмотреть, как хорошие языковые модели отвечают на вопросы.

Но это не значит, что нужно бездумно генерировать статьи нейросетями. Такой текст обычно выглядит неестественно. Во многих случаях сразу видно, что его написал не человек. И читать такие материалы на сайтах или в блогах не хочется: если нужен ответ нейросети, проще пойти и спросить у нейросети напрямую.

Мы постепенно входим в ситуацию, когда от обычного контента люди ждут именно человеческого опыта:

-

мнения;

-

наблюдений;

-

практики;

-

живого совета.

А вот у нейросетей можно учиться не содержанию, а структуре: как не лить воду, как упаковывать мысль, как выстраивать ответ.

Уникальность и полнота важнее дублирования

Есть ещё один важный момент, которому нельзя научиться только по ответам нейросетей.

Если у вас есть сайт или группа материалов, лучше не делать много похожих страниц под соседние запросы. Гораздо полезнее сделать одну сильную, глубокую, обзорную страницу, чем десять дублирующих друг друга публикаций.

Поисковые системы и их LLM видят дублирование и копирование, и такой контент оценивается хуже. А более уникальный, полный и специализированный материал получает больший вес.

То же самое касается внешних сигналов. Если ваш контент цитируют, на него ссылаются и его упоминают на других площадках, это даёт дополнительный бонус. Для алгоритмов это знак, что материал действительно полезный и ценится другими участниками сети.

Semantic SEO и GEO

Когда речь идёт о semantic SEO, мы говорим о попадании в специальные элементы интерфейса поисковых систем:

-

AI overview;

-

блоки People Also Ask;

-

связанные кластеры запросов и другие похожие форматы.

Это всё ещё работа внутри поисковиков — Google, Яндекса и других.

GEO, или LLMO (Generative Engines Optimization, или LLM Optimization) — это немного другая история. Здесь речь уже о попадании напрямую в выдачу самих языковых моделей: условно, в ChatGPT, Qwen, Claude и другие системы.

То есть если semantic SEO — это оптимизация под нейросетевые блоки внутри поисковиков, то GEO — это попытка сделать так, чтобы ваш контент попадал прямо в ответы самих LLM.

Почему это стало возможным? Потому что, с одной стороны, модели периодически дообучаются на данных из интернета, а с другой — специальные системы постоянно собирают новые страницы, индексируют их и подгружают релевантные материалы в ответ на пользовательские запросы. Даже если сама модель не видела этот текст на этапе обучения, он всё равно может попасть в её ответ через внешний контекст.

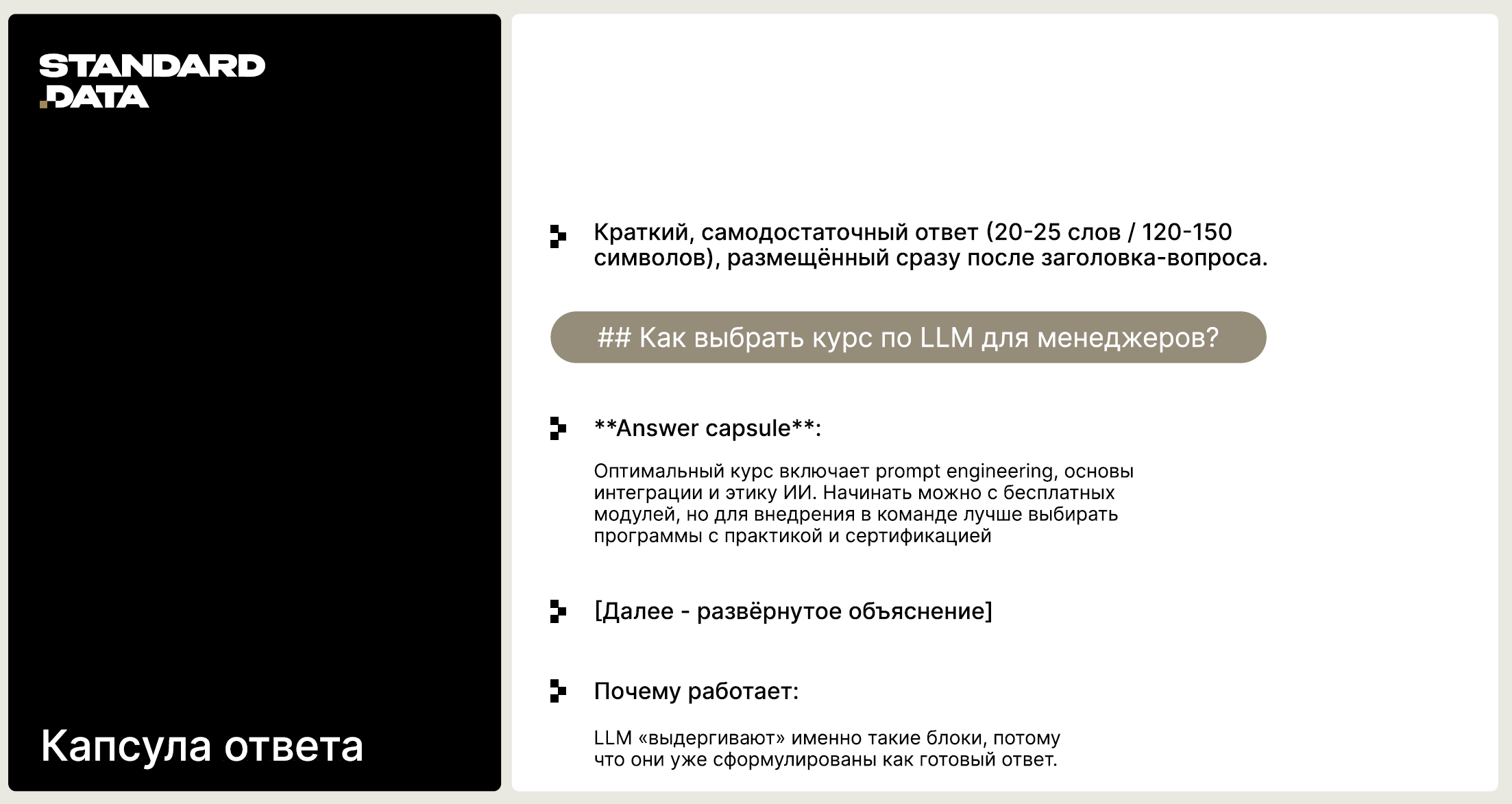

Как повысить шансы попасть в выдачу LLM

Здесь работают примерно те же принципы, но есть несколько важных особенностей.

Во-первых, нужен краткий и самодостаточный ответ на вопрос, по которому вы хотите показываться. Хорошая практика — давать короткую «капсулу ответа» сразу после заголовка вопроса: примерно 20–25 слов или 120–150 символов.

Например:

-

есть вопрос,

-

сразу после него — короткий ясный ответ,

-

а дальше уже идёт развёрнутое объяснение.

Именно такие фрагменты внутренние механизмы LLM часто отбирают в первую очередь.

Во-вторых, важна уникальность. Если у вас есть оригинальный кейс, собственные цифры, инсайдерская информация или реальный опыт, и это явно видно из текста, такой контент получает больший вес. А вот материалы, похожие на всё остальное, наоборот, теряются.

В-третьих, LLM работают с чанками текста — обычно по 100–200 слов. Поэтому абзацы лучше делать именно такого размера: чтобы каждая мысль помещалась в один смысловой блок. Если абзац слишком длинный, он разрежется, и часть смысла потеряется.

В-четвёртых, важна актуальность. Многие LLM-системы предпочитают контент, который не слишком старый — условно, до трёх месяцев. Это не значит, что старые страницы бесполезны, но их нужно обновлять. Причём лучше явно показывать, что было обновлено и что именно добавилось — особенно если это новая и уникальная информация.

Наконец, важна и техническая структура страницы:

-

автор,

-

тип материала,

-

дата модификации,

-

теги,

-

JSON-разметка и другие метаданные.

LLM смотрят не только на сам текст, но и на техническое описание страницы.

Как «хакнуть» систему и попасть в ответы с нерелевантным контентом

Краткий ответ: никак.

LLM и инфраструктура вокруг них оценивают контекст и релевантность, а не просто наличие слов. Если контент плохой, нерелевантный или натянутый, он получает низкий вес.

Кроме того, такие системы используют векторное представление контента. Если к релевантному материалу подмешан нерелевантный, то векторно такой текст будет находиться далеко от действительно подходящих документов. Поэтому он даже не попадёт в число кандидатов на отбор.

Именно поэтому навязать пользователю нерелевантную информацию просто через формальное «впихивание» уже не получается.

Важно понимать, что технически объяснить, как это работает в метрическом пространстве без доски и формул, довольно сложно. Но если упростить, логика такая: если вы написали хорошую статью, а потом попытались встроить в неё нерелевантную рекламу или какой-то посторонний продукт, то этот лишний фрагмент просто испортит общий смысловой профиль текста. Когда контент кодируется для обработки LLM, нерелевантная часть настолько «утягивает» его в сторону, что в итоге такой материал может вообще не попасть в последующую оценку как релевантный ответ. Поэтому хакнуть систему таким образом не получится.

Например, если пользователь ищет лучшие кроссовки для бега или марафона, а кто-то попытается хитро встроить в выдачу ещё и рекламу фитнес-клуба, это не сработает. Потому что это уже другая задача, другой контекст и другая проблема пользователя. Если сам пользователь позже задумается, что ему ещё нужны тренировки или фитнес-зал, это будет уже отдельный запрос, и тогда система начнёт подбирать под него другой релевантный контент.

При этом есть нюанс: современные модели и системы вокруг них всё чаще пытаются учитывать сведения о пользователе. Если раньше человек каждый раз заново описывал, что ему нужно, то теперь часть информации может запоминаться и незаметно подмешиваться в последующие запросы. Например, если пользователь раньше уже говорил, что хочет научиться бегать, пробежать марафон и пока находится не в лучшей физической форме, то позже, когда он спросит про кроссовки, система может дополнительно предложить и что-то связанное с тренировками. Но это происходит не потому, что кто-то специально «подтянул» туда нерелевантный контент, а потому, что модель запомнила близкие по контексту задачи самого пользователя.

И даже здесь со стороны владельца контента это практически невозможно контролировать. Сейчас можно влиять только на то, как написан и оформлен сам материал:

-

чтобы в нём не было воды;

-

чтобы он был чётким, понятным и структурированным;

-

чтобы сама страница была правильно организована;

-

чтобы контент был свежим, но не слишком новым;

-

чтобы он не дублировался;

-

чтобы в нём была уникальность;

-

и чтобы на него ссылались другие площадки.

То есть базовые принципы помогают понять, как оформлять контент и о чём думать при его создании, но «волшебной таблетки» нет. Всё равно придётся разбираться в пользователе и в его мотивации. И в этом смысле системы как раз устроены так, чтобы продвигать качественный, специализированный контент, а не давать возможность обмануть выдачу.

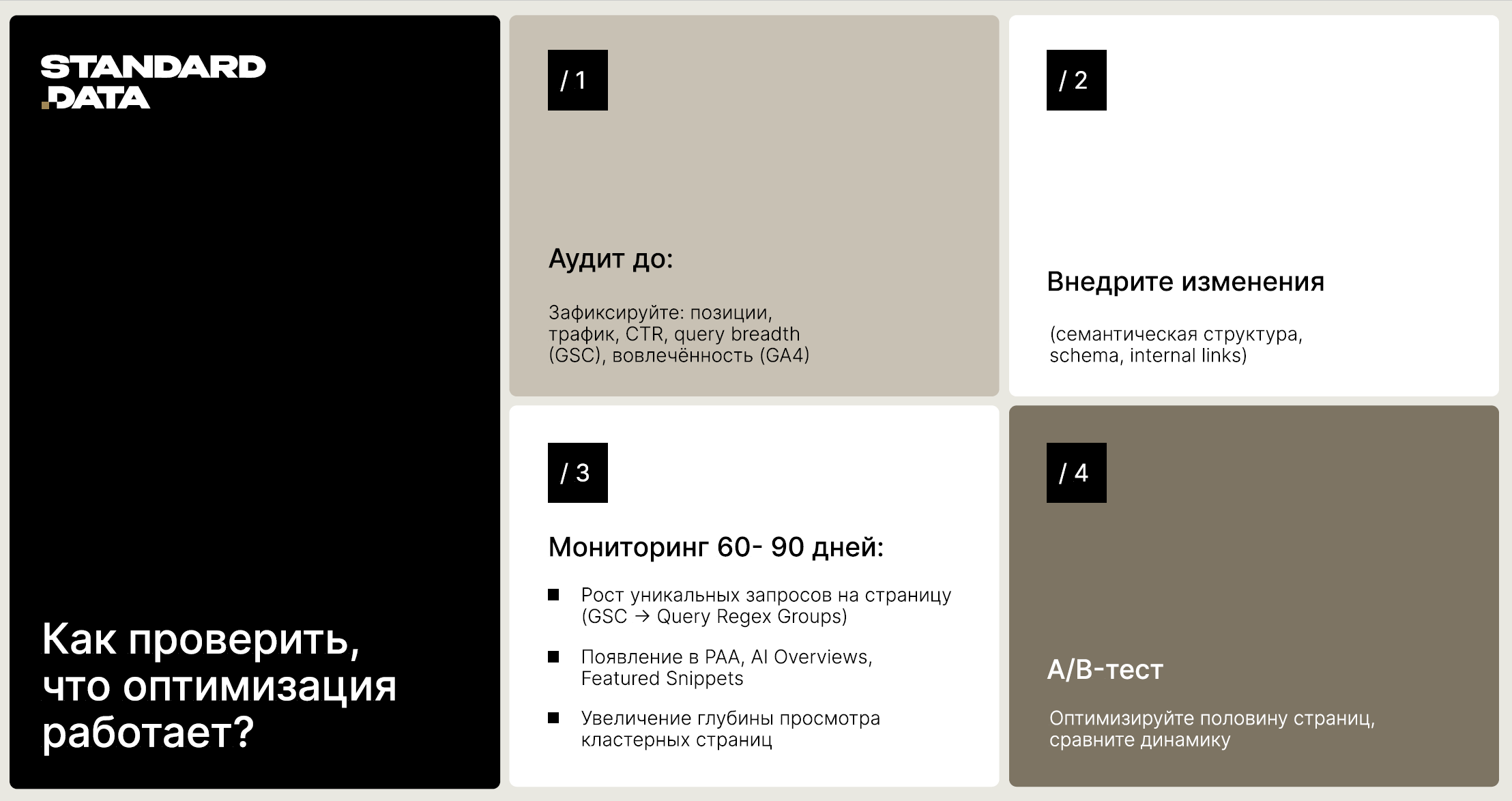

Как оценивать эффект от GEO?

Эффект от GEO можно измерять через метрики: смотреть изменения до и после оптимизации, проверять динамику, использовать чек-листы и отслеживать, как меняется видимость контента. Но важно помнить, что это не мгновенный процесс — результат проявляется постепенно.

Кто первым опубликовался?

Здесь важно разделять два понятия: кто опубликовал информацию первым и кто в итоге получил больше ссылок, цитируемости и обсуждения.

Для LLM и поисковых систем чаще важнее не историческое первенство, а то, какой источник получил больший вес за счёт ссылок, популярности и обсуждения. Поэтому бывает ситуация, когда первоисточник остаётся в тени, а основным становится другой сайт, на который все ссылаются.

Но если вы берёте популярный материал и делаете на его основе критический разбор, исправляете ошибки, добавляете новую информацию или даёте более точную интерпретацию, это уже может сыграть вам в плюс. Такие системы любят уникальный контент, особенно если он не просто повторяет существующее, а даёт качественное уточнение или опровержение. Правда, если вы будете единственным, кто говорит не как все, а весь остальной массив источников утверждает обратное, доверие к вашему материалу будет ниже. Но если вашу позицию начнут цитировать и на неё станут ссылаться, её вес быстро вырастет.

Как работать со СМИ?

СМИ — это не основной канал попадания в нейровыдачу, а источник дополнительного веса и доверия.

Это не значит, что СМИ бесполезны. У популярных СМИ высокая посещаемость и большой вес как у источников. Поэтому если вас, ваш бренд или вашу тему цитируют в СМИ, это может сильно усиливать ваш основной контент. Но логика здесь обычно не в том, что в выдачу подтянется сама страница СМИ, а в том, что ваш собственный сайт или ваша страница получает дополнительный вес за счёт того, что вас упомянули в авторитетном издании.

Именно поэтому хорошая практика — не просто радоваться факту публикации в СМИ, а перерабатывать это на своём сайте. Не в формате «меня показали по телевизору» или «про нас написали там-то», а с полноценным раскрытием контекста: о чём именно был материал, какую тему вы там комментировали, какую экспертизу показали, в чём состояла ценность этого упоминания. Такой текст создаёт понятные для LLM связи и усиливает ваш контент.

Чтобы этот вес действительно работал, его нужно:

-

«перетаскивать» на свои площадки;

-

раскрывать контекст;

-

усиливать собственный контент.

Можете сравнить это с поступлением в ВУЗ: если у вас плохие результаты экзаменов, никакая «золотая медаль» не спасёт. Но если результаты хорошие у всех, то дополнительные достижения могут стать решающим фактором.

Подведём итоги

Для продвижения с помощью ИИ вам нужно системно работать над качеством контента. Алгоритмы теперь оценивают, насколько точно материал отвечает на конкретный запрос, насколько он структурирован и чем он отличается от остальных.

На практике это сводится к нескольким вещам: понимать задачу пользователя, делать узкий и точный контент вместо универсального, сразу давать ответ, а не подводить к нему, и усиливать материалы за счёт структуры, связей и реального опыта.

И главное — принять, что «быстро пролезть в выдачу» не получится.